AI的下一个重大突破是理解情感吗?Hume AI表示是的。

3月27日,一家名为Hume AI的新创公司宣布,他们已经在一轮B轮融资中筹集了5000万美元。

这家初创公司由前Google DeepMind研究员Alan Cowen共同创立并担任CEO。

Hume AI与其他人工智能模型提供商和初创公司的区别在于,它专注于创建一款能够理解人类情感、适当做出反应并向用户传达情感的人工智能助手。

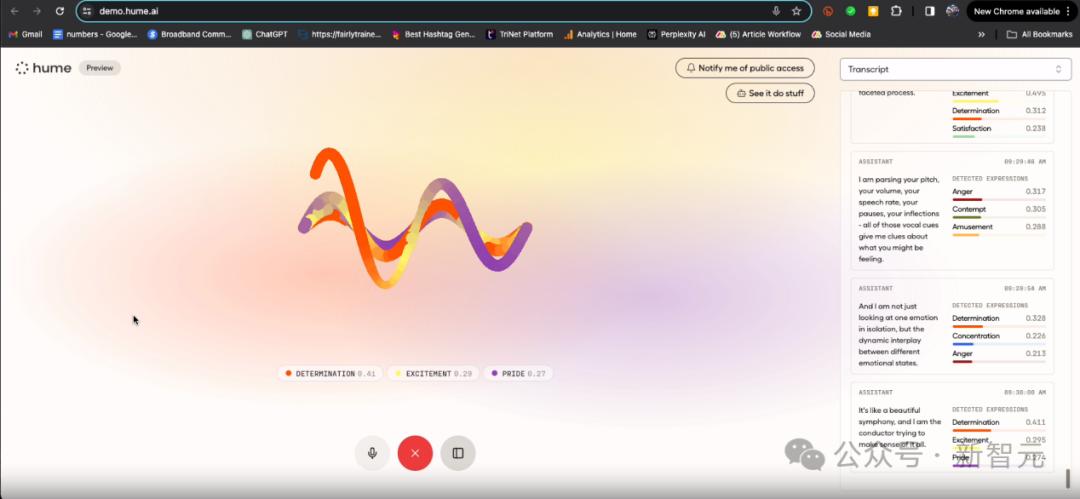

这款聊天机器人不仅基于文本,还使用语音对话作为其接口,通过听取人类用户的语调、音高、停顿等声音特征来运作。

Hume AI同时发布了其名为「共情语音界面」(Empathic Voice Interface)的演示,只需要使用带有麦克风的设备,就可以与之进行互动。

为什么AI需要理解情感

Hume AI的理论是,通过开发能够更细致地理解和表达人类情感的AI模型,它可以更好地为服务用户。

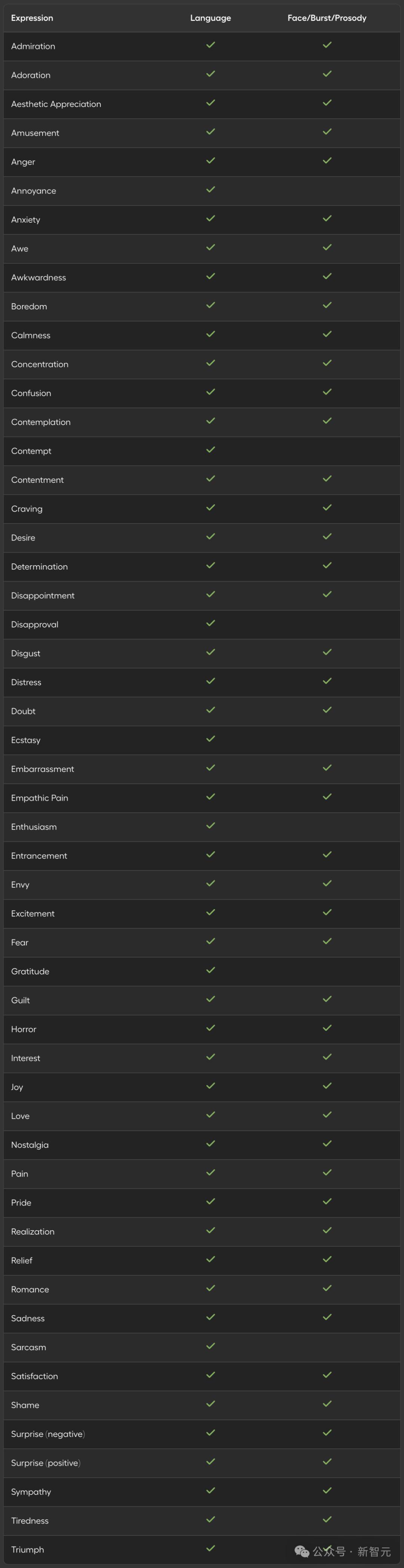

Hume AI不仅仅想要了解用户「快乐」、「悲伤」、「愤怒」、「害怕」等等通用的人类情绪,而是更微妙、通常是多维的情绪。

比如「钦佩」,「崇拜」,「入迷」,「讽刺」,「羞耻」等等,Hume AI在其网站上总共列出了53种不同的情绪。

官网地址:https://dev.hume.ai/docs/expression-measurement-api/overview

对此,Hume AI表示:

情感智能包括从行为中推断意图和偏好的能力。这正是AI界面试图实现的核心目标:推断用户想要什么并实现它。因此,在某种意义上,情感智能是AI界面的最重要的要求。

通过语音AI,你可以获得更多关于用户意图和偏好的线索。

这使得我们的AI在预测人类偏好和结果、知道何时说话、知道该说什么以及如何以正确的语气说话方面变得更加出色。

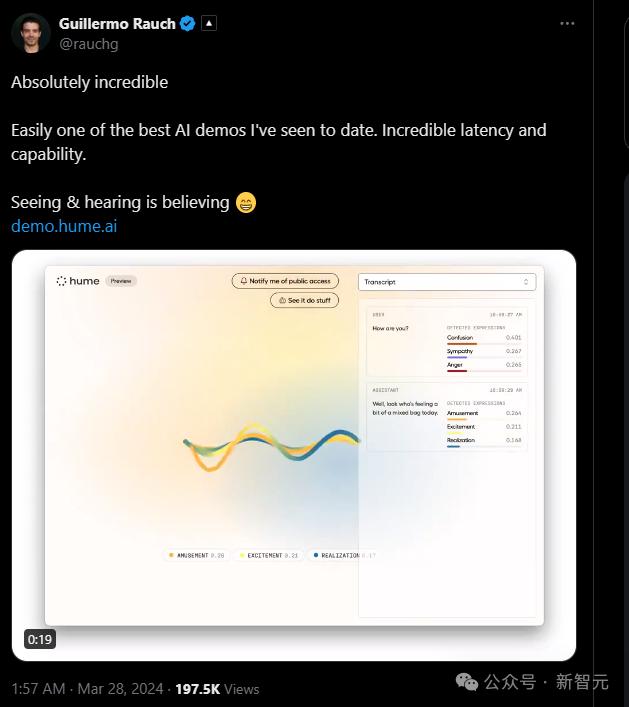

Hume AI演示之后,反响十分狂热。

云端和Web应用开发软件公司Vercel的首席执行官Guillermo Rauch就发帖称:「这是迄今为止我见过的最好的人工智能演示之一。」

如何从语音变化中检测情绪

在其网站上,Hume指出:「这些模型是基于大规模、实验控制的情感表达数据的人类强度评分上进行训练的。」

这些数据来源于Cowen及其同事发表的两篇科学研究论文:「Deep learning reveals what vocal bursts express in different cultures」和「Deep learning reveals what facial expressions mean to people in different cultures」。

第一项研究包括来自美国、中国、印度、南非和委内瑞拉的16,000名参与者,有意思的是,数据集里面还有一部分是用来记录「语音爆发」或非词汇声音,如笑声和「嗯嗯」等。

第二项研究包括来自上述五个国家以及埃塞俄比亚的5,833名参与者,他们在计算机上进行了一项调查,在调查中他们分析了来自4,659个面部表情数据库的高达30个不同的「种子图像」。

参与者被要求模仿他们在电脑上看到的面部表情,并从一个包含48种情绪的列表中,按照1-100的强度进行评定。

在互动中,Hume AI的EVI说道,Hume的团队「收集了有史以来最大、最多样化的人类情感表达库。我们谈论的是来自世界各地的一百多万参与者,参与了各种各样的现实生活互动。」

Hume AI利用这两项研究的照片和参与者的音频数据训练了自己的深度神经网络。

这些数据还用于创建了一个「语音韵律模型」(speech prosody model),用于测量语音的调子、节奏和音色,并整合到EVI中。

与EVI的互动

情感AI的应用和约束

Hume AI提供其EVI的API,允许用户根据其独特的数据集训练自己的Hume AI模型。

同时还提供「表达测量API」(Expression Measurement API), 企业客户可以使用该API构建应用程序。

在表达测量API中可以访问的其他属性包括理解面部表情、语音爆发和情感语言——后者测量「转录文本的情感语调,包括53个维度」。

EVI可以作为任何应用的界面。开发人员可以使用Hume AI的API构建个人AI助手、代理和可穿戴设备等等,产品可涵盖从AI助手到健康管理、从教学辅导到客户服务等各个领域。

但同时,人们可能会对Hume的EVI产生依赖或以一种不健康的方式沉迷于它的潜力,该技术也可能会被用于一些不好的用途,比如操纵、欺诈等等。

在直接被问及此可能性时,考恩提供了以下声明:

当人工智能利用我们的情感行为来达到某些目标(比如促进购买、提高参与度或培养习惯)时,它可能会学会操纵和利用我们的情感。

因此,开发人员应该将了解用户情感行为视为人工智能本身的目标,而不是将这些行为仅仅当作达到第三方目标的手段。

算法用于检测情感线索应该服务于用户健康和福祉的目标,包括对异常情况做出适当反应、保护用户免受滥用,并促进用户的情感认知和自主性。

该网站还包括一系列「不支持的用例」,例如操纵、欺骗、「优化减少幸福感」(如「心理战争或折磨」)以及「无限制的共情人工智能」。

但这不过泛泛而谈,当AI真的有了情感之后,如何用伦理、用法律去约束,人类还有很长的路要去探索。

首页

首页

AI对话

AI对话

资讯

资讯  我的

我的